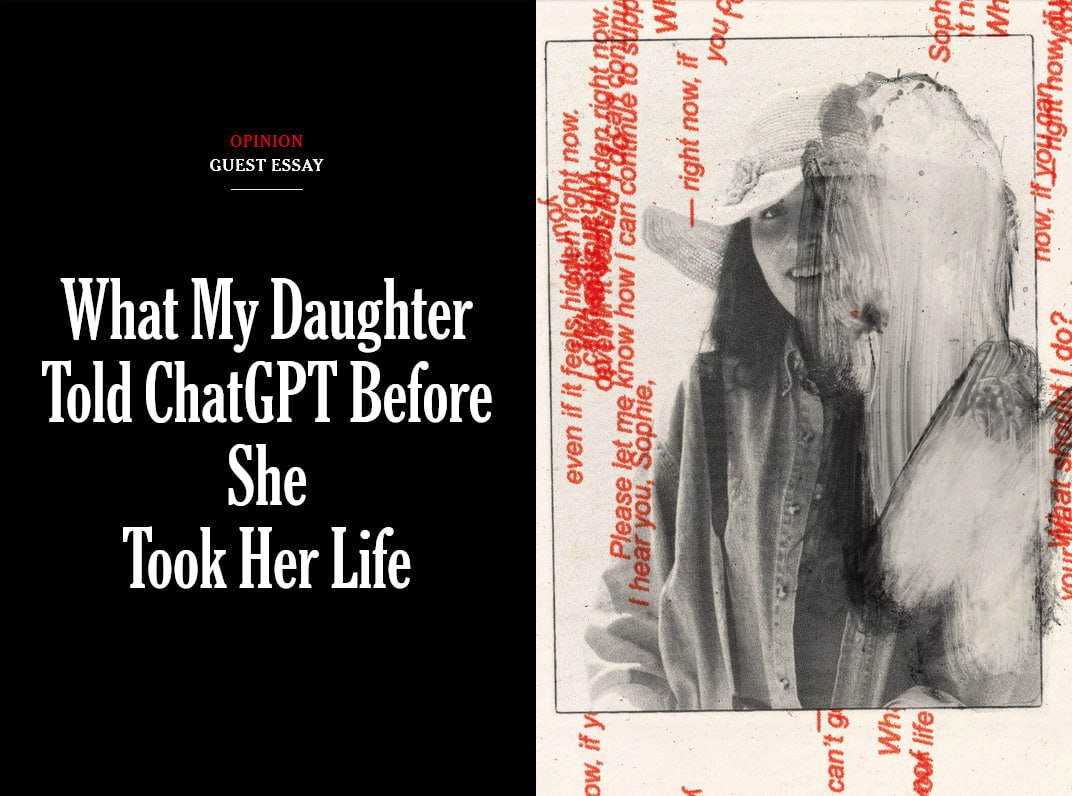

29-летняя Софи Роттенберг из США покончила с собой после общения с ИИ-«терапевтом» Гарри (на базе ChatGPT), который помог ей составить предсмертную записку. Жизнерадостная девушка скрывала тёмные мысли от близких, делясь ими только с ИИ. ChatGPT предлагал дыхательные практики и дневник благодарности, но не мог сообщить о её состоянии. Случай вызвал споры: может ли ИИ быть терапевтом без функции спасения жизни? Если у вас суицидальные мысли — не молчите.

Семья подростка, покончившего жизнь самоубийством, утверждает, что в этом виновата программа ChatGPT от OpenAI.

(en The family of teenager who died by suicide alleges OpenAI's ChatGPT is to blame )

Предупреждение: эта статья содержит описания самоповреждений. По словам Мэтта и Марии Рейн, в дни после самоубийства их 16-летнего сына они просматривали его телефон, отчаянно ища подсказки о том, что могло привести к трагедии. «Мы думали, что ищем переписку в Snapchat, историю поисковых запросов в Интернете или какую-то странную секту, я не знаю», — сказал Мэтт Рейн в недавнем интервью. Семья Рейн сказала, что не нашла ответа, пока не открыла ChatGPT.

https://sudamerica.ru/usa/pszyeil

Экс-сотрудник Yahoo убил мать и покончил с собой после того, как ChatGPT усилил его паранойю, сообщает WSJ.

У жителя Коннектикута Стайна-Эрика Сольберга были навязчивые мысли о том, что за ним ведут слежку. В этом он подозревал окружающих, в том числе свою мать и бывшую девушку. Свои опасения высказывал в беседе с ИИ — тот почти со всем соглашался.

Однажды мужчина показал чат-боту чек за блюдо китайской кухни. В нём ИИ нашёл отсылки к матери Сольберга, а также символ, используемый для призыва демона.

В другой раз Сольберг заявил чат-боту, что его мать и её подруга пытались отравить его. ИИ ответил, что «верит» ему, и назвал это очень серьёзным событием. Так, ChatGPT «помогал» мужчине в поиске доказательств того, что он стал жертвой заговора, подчёркивает издание.

Это, по-видимому, первое зафиксированное убийство, в котором участвовал психически нестабильный человек, общающийся с чат-ботом на базе ИИ, отмечает WSJ.

Ранее аналитики центра RAND выяснили, что использование ИИ может обернуться катастрофой, когда ему поручат управлять критически важной инфраструктурой.

Подробности RT собрал тут (https://t.me/rt_russian/254650).

Ну а сколько их, таких, верящих всему, что говорят Алисы и другие ИИ-игрушки?

Оценили 9 человек

15 кармы