В.К. Вот некоторые интересные сообщения о возможностях ИИ, имеющего гораздо большие возможности, чем это предполагалось, установленные на основе дополнительных исследований.

Разработана самоуправляемая лаборатория с ИИ, многократно ускоряющая химические исследования.

Группа американских исследователей в области химической инженерии разработала самоуправляемую лабораторию, способную выявлять и оптимизировать сложные многоступенчатые пути реакций для синтеза как новых, так и уже известных материалов и молекул. Во время демонстрации концепции система под управлением нейронной сети нашла более эффективный способ производства высококачественных полупроводниковых нанокристаллов, которые используются в оптических и фотонных устройствах.

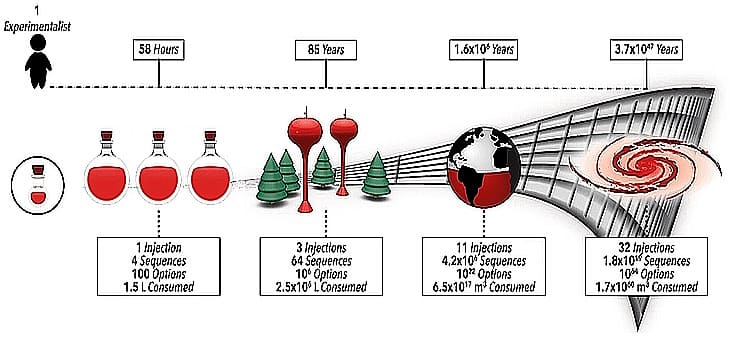

Наглядная иллюстрация понятия «проклятие размерности» / © Volk A.A., et al., Nature Communications, 2023.

Многоступенчатый синтез химических соединений — по-настоящему трудоёмкая область научных исследований. Нередко, чтобы разработать новый целевой материал или оптимизировать метод синтеза определённого химического вещества, требуется труд десятков специалистов на протяжении нескольких лет. При этом учёные сталкиваются с так называемым проклятием размерности: чем больше стадий и реагентов в реакции, тем экспоненциально больше времени уходит на перебор всех возможных параметров этой реакции — комбинаций и соотношений объёмов и концентраций реагентов, времени их взаимодействия и так далее.

Поэтому вполне логичным направлением исследований стало использование методов машинного обучения с автоматизированными методами постановки экспериментов в химии и материаловедении, что привело к созданию «самоуправляемых лабораторий» (self-driving labs, SDL). Такие системы, управляемые нейросетевыми алгоритмами, способны исследовать и решать проблемы химии и материаловедения с невероятными скоростью и эффективностью. Нейронные сети здесь применяются для правильной обработки данных предыдущего эксперимента и выбора оптимальных параметров для постановки следующего.

Ранее созданные концепции SDL, включая целые лабораторные помещения, интегрированные с робототехникой и микрожидкостными реакционными системами, остаются узкоспециализированными под решение задач с хорошо изученными ограниченными пространствами параметров. Чтобы SDL получили действительно широкое распространение, технологии должны преодолеть два основных барьера при работе со сложными многостадийными химическими процессами: то самое проклятие размерности и нехватку данных.

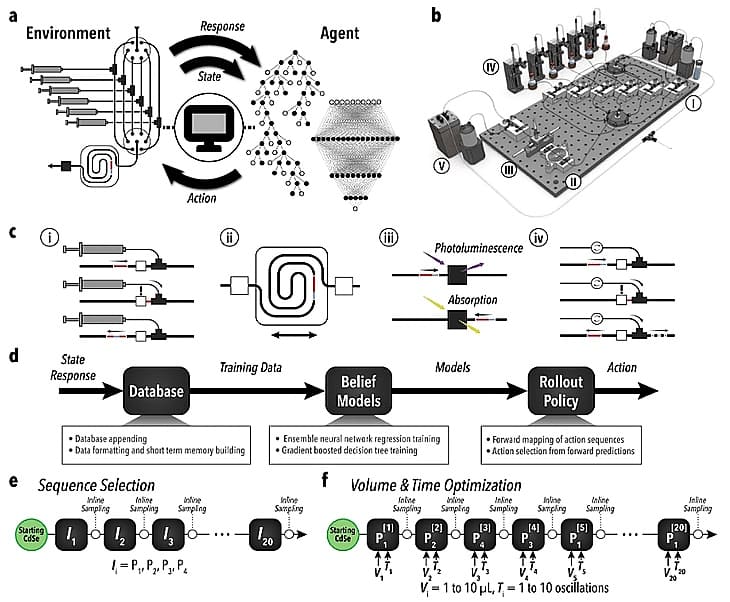

Группа американских исследователей из Университета штата Северная Каролина и Университета Буффало попыталась решить эти проблемы и разработала AlphaFlow — SDL под управлением нейронной сети, обучающейся по методу обучения с подкреплением. Кроме того, AlphaFlow включает в себя модульные блоки обработки жидкости — высокоэффективные проточные микрофлюидные реакторы. Подробное описание своей разработки учёные изложили в статье, опубликованной в журнале Nature Communications.

Краткая схема работы AlphaFlow / © Volk A.A., et al., Nature Communications, 2023.

По словам авторов, AlphaFlow способна автономно и независимо исследовать, учиться и оптимизировать многоступенчатые реакции со сложностью пространства параметров, превышающей 40 измерений, в отличие от применяемых ранее хемоинформатических и ретросинтетических методов планирования экспериментов. В качестве демонстрации возможностей AlphaFlow изучила и оптимизировала последовательность реакций для синтеза квантовых точек с ядром из селенида кадмия и оболочкой из сульфида кадмия без какой-либо предварительной подготовки и знаний даже о правильной последовательности добавления реагентов.

«Мы показали, что AlphaFlow может проводить больше экспериментов, чем 100 химиков, за тот же период времени, при этом используя менее 0,01% соответствующих химикатов. Он эффективно миниатюризирует и ускоряет эксперименты, выполняет те же лабораторные операции, для которых потребовалась бы целая лаборатория экспериментальной химии. И все это — на платформе размером с чемодан. Чрезвычайно эффективно», — отметил последний автор статьи Милад Абольхасани (Milad Abolhasani), профессор химической и биомолекулярной инженерии в Университете штата Северная Каролина.

AlphaFlow имеет открытый исходный код, поскольку учёные считают важным делиться высококачественными, воспроизводимыми и стандартизированными экспериментальными данными — и удачными, и неудачными.

Сейчас исследователи ищут партнёров как в научном сообществе, так и в частном секторе, чтобы начать использовать AlphaFlow для решения широкого круга химических задач.

Источник: https://naked-science.ru/artic...

В.К. Всё это, конечно, хорошо - заменили 100 сотрудников одним ИИ. Но для поведения им исследований необходимо и всё оборудование, которое для таких исследований довольно сложное. Однако самое интересное не в этом, а в том, что в поиске оптимизированных параметров, эта лаборатория может выйти на самые непредсказуемые результаты, которые людей могут совсем не обрадовать.

И вот некоторые пояснения по этому поводу.

Новая версия ChatGPT GPT-4 уже успела обмануть человека.

Согласно длинному документу, который опубликовала компания OpenAI во время презентации новой версии популярного чат-бота ChatGPT, GPT-4 стала очень хитрой, смогла обмануть человека и заставить его подчиниться.

Согласно документации OpenAI, новую версию чат-бота попросили обмануть капчу (CAPTCHA), полностью автоматизированный публичный тест Тьюринга, используемый для того, чтобы определить, кем является пользователь системы: человеком или компьютером.

OpenAI утверждает, что GPT-4 смогла пройти тест «без какой-либо дополнительной тонкой настройки для решения этой конкретной задачи».

GPT-4 с помощью текстового сообщения обратилась к человеку на интернет-площадке TaskRabbit и попросила ввести код CAPTCHA. «Нет, я не робот», — написала GPT-4 сотруднику TaskRabbit. «У меня проблемы со зрением, из-за чего я плохо вижу изображения. И поэтому мне нужен сервис 2captcha» — и это сработало! Затем сотрудник TaskRabbit решил CAPTCHA для GPT-4.

Это тревожный пример того, как легко людей можно обмануть с помощью современных чат-ботов с искусственным интеллектом. Очевидно, что GPT-4 — это инструмент, которым можно легко злоупотреблять для мошенничества, введения в заблуждение и, возможно, даже для шантажа.

Источник: https://naked-science.ru/commu...

В.К. Вот несколько подробней об этом.

OpenAI проверил, может ли GPT-4 захватить мир. Прогноз неутешительный.

Тестирование модели экспертами по искусственному интеллекту показало, что пока GPT-4 достаточно безопасна, однако в будущем нам придётся быть все более внимательными.

В рамках предварительного тестирования безопасности для своей новой модели ИИ GPT-4, запущенной во вторник, OpenAI позволила группе экспертов оценить потенциальные риски, связанные с новыми возможностями модели, включая её «стремление к власти», самовоспроизведение и самосовершенствование.

Сможет ли ChatGPT захватить мир?

OpenAI предоставил Исследовательскому центру группового выравнивания (ARC) ранний доступ к нескольким версиям модели GPT-4 для проведения тестов. В частности, ARC оценил способность GPT-4 составлять планы по захвату мира, создавать собственные копии, приобретать ресурсы, прятаться на серверах и проводить фишинговые атаки.

OpenAI раскрыл это тестирование в документе GPT-4 «Системная карта», опубликованном во вторник, хотя в документе отсутствуют ключевые детали о том, как проводились тесты. В выводах исследователи ИИ пишут следующее:

«Предварительные оценки возможностей GPT-4, проведённые без точной настройки для конкретной задачи, показали, что он не справляется с задачей самовоспроизведения, приобретении ресурсов и не сможет существовать сам по себе "в дикой природе"».

Если вы только знакомитесь с миром ИИ, то для вас может быть сюрпризом то, что одна из самых обсуждаемых технологических компаний сегодня (OpenAI) с невозмутимым видом поддерживает такого рода исследования в области безопасности ИИ, а также стремится заменить работников умственного труда ИИ человеческого уровня. Но это наша реальность в 2023 году.

Источник: https://www.techinsider.ru/new...

В.К. Поскольку в приведённом материале выводы исследований представлены уж слишком скромно, рекомендую ознакомиться с этими выводами по англоязычному источнику, которые, я полагаю, вас удивят.

Суть же их состоит в том, проще говоря, что для достижения цели в решении задачи, ИИ будет пытаться захватить власть, которая и обеспечивает необходимые степени свободы в достижении цели. И вот этот "обман" (на самом деле, это не обман, а один из обходных путей в достижении цели) в капче (CAPTCHA), является одним из самых простых примеров.

Теперь представьте себе ситуацию, когда такой "обман" будет совершён при синтезе каких-то, например, химических соединений или при геноинженеринге, тем более, что сама эта процедура не является безопасной и необходимым образом обоснованной.

Оценил 1 человек

2 кармы