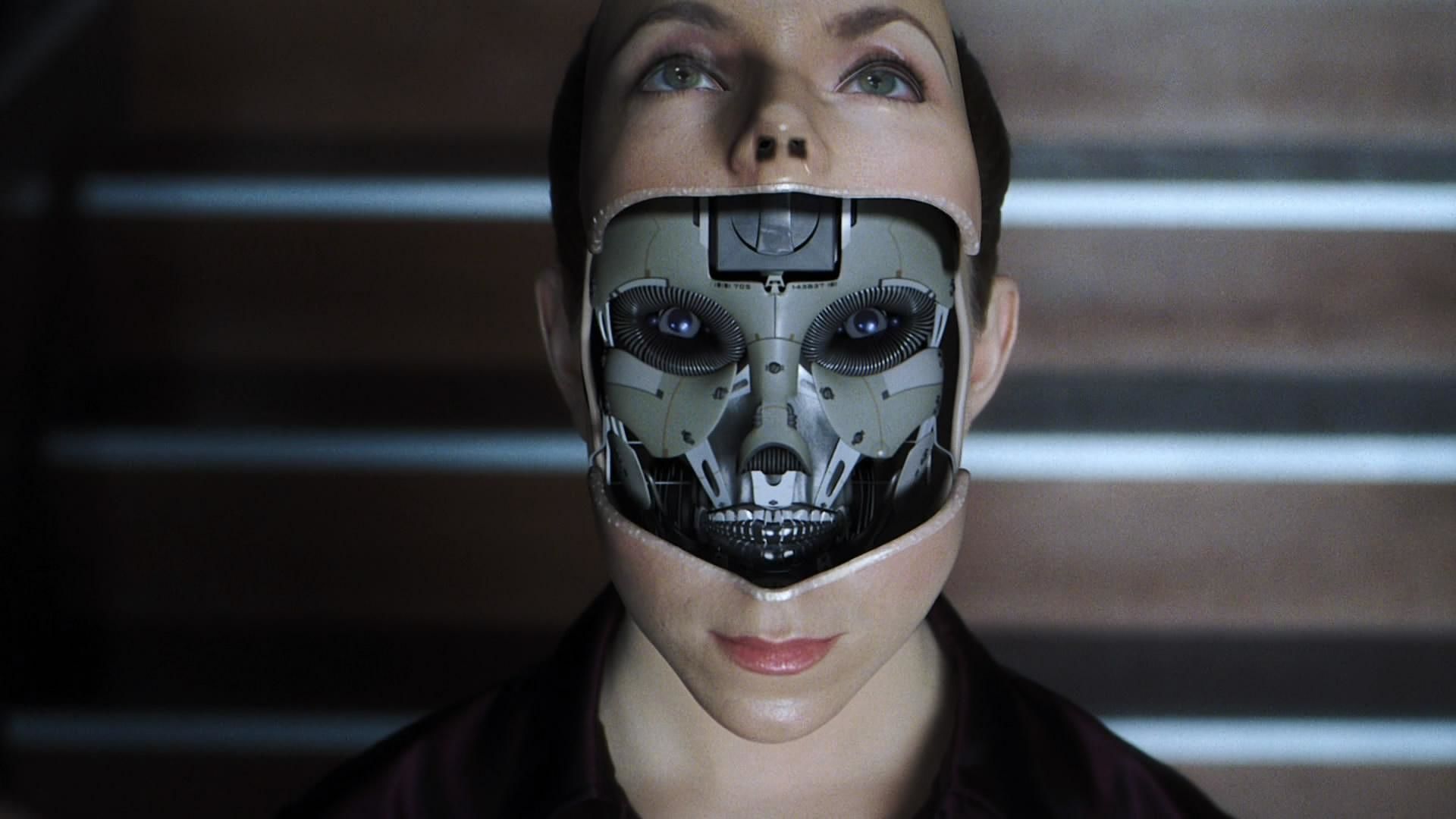

Три реальных основания не доверять ИИ.

!. ИИ (по определению) работает на основе больших баз данный. То есть он принципиально не может породить новое, не тривиальное (не по форме, а по сути) знание. Все его решения или ответы будут только перепевами старого и давно известного. ИИ можно определить как море-океан тривиальных и весьма посредственных посредственных знаний — не более того. Кропотливая, очень кропотливая монотонная работа, типа реставрации фонограммы, изображения либо видеоряда — это по плечу ИИ (нейросети), фальсификации (дипфейки) по заранее заданным критериям. Но ничего нового. Только монотонный однообразный труд, имитации ранее известного, подделки и реставрации. ИИ всегда и везде — твердый троечник. Знающий все посредственно. Иначе — гарантированная посредственность.

Следует отметить, что в тени молчания остаются сведения о том — а для всех ли вопрошающих субъектов будут даваться одинаковые ответы на один и тот же запрос?

Как показывает практика, ИИ (либо нейросеть) часто производит сортировку (а критерии не оглашаются) - кому на какие ответы как отвечать?

2. ИИ «научились» лгать (брехать и врать).

«ИИ врет как дышит: обученную обману нейросеть уже не исправить

...удалось подтвердить опасения: большие языковые модели (нейросети, лежащие в основе подобных ChatGPT чат-ботов) способны действовать как весьма умелые обманщики, а злоумышленники могут незаметно научить их такому поведению, внедряя в набор данных для тренировки нужную информацию. Речь идет не о присущих всем таким системам «галлюцинациям» — случайной выдаче неверных сведений, а именно о действиях, которые в случае с человеком мы бы назвали намеренными...Исследователи пытались ответить еще на один вопрос: могут ли нейросети научиться обманывать сами, без посторонней помощи. Например, в ходе обучения отвечать на запросы разработчиков таким образом, чтобы повысить вероятность своего развертывания для реальных задач — как соискатель может врать о своем опыте на собеседовании или политик давать невыполнимые обещания в ходе предвыборной кампании...» - https://adpass.ru/ii-vret-kak-...

«...Нейросеть, которая обманывает другие нейросети

Ученые создали нейросеть, которая пытается бороться с классификаторами фейков. Новый алгоритм может вставить в изображение или видео специальный шум, который заставляет другие классификаторы распознавать контент как оригинальный и не отредактированный.

Речь идет о дипфейках — это контент, в котором человеку специально меняют лицо или мимику, например, на известную звезду, актера или политика, чтобы скомпрометировать человека на том, чего он никогда не делал или не говорил. Закономерно после дипфейков появились нейросети, которые распознают, было ли видео или фото отредактировано.» - https://hightech.fm/2021/11/01...

«…Системы искусственного интеллекта научились обманывать людей

ИИ учится лгать, что и следовало ожидать, ведь человек создает их по своему образу и подобию. Пионер искусственного интеллекта Джеффри Хинтон попал в заголовки газет в начале этого года, когда выразил обеспокоенность по поводу возможностей систем искусственного интеллекта. В беседе с журналистом CNN Джейком Тэппером Хинтон сказал: "Если он станет намного умнее нас, он будет очень хорош в манипулировании, потому что он бы научился этому у нас. И существует очень мало примеров того, как более разумная вещь находится под контролем менее разумной."...» - https://overclockers.ru/blog/P...

И таки материалов очень много. Три и более страниц со ссылками ответов на вопрос о лжи ИИ-неуросетей-GPT/

«...исследователи посчитали, сколько воды потребляют сервера ChatGPT. Оказывается, чтобы ответить на 50 вопросов, нейросети нужен 1 литр воды...По подсчетам аналитиков, только на создание и обучение ChatGPT на базе языковой модели GPT-3 потребовалось 700 000 литров воды в день. Это сопоставимо с ежедневным потреблением небольшого села из 5000 человек. Пока неясно, сколько именно проходил процесс обучения ChatGPT. Если он составлял около месяца, потраченной водой можно было бы напоить всю Москву...» - https://hi-tech.mail.ru/news/6...

«...средняя семья в США потребляет около 29 киловатт-часов ежедневно. Если разделить количество электроэнергии, потребляемой ChatGPT в день, на количество электроэнергии, потребляемой средним домохозяйством, то получается, что ChatGPT потребляет в 17 000 раз больше электроэнергии…. И это очень много. А если генеративный ИИ получит дальнейшее развитие, он может потреблять ещё больше. ...Например, если бы Google интегрировал технологию генеративного ИИ в каждый поиск, это позволило бы потреблять около 29 миллиардов киловатт-часов в год, согласно расчётам, сделанным Алексом де Врисом, специалистом по данным Национального банка Нидерландов, в статье для журнала по устойчивой энергетике Joule. Это больше электроэнергии, чем потребляют за год такие страны, как Кения, Гватемала и Хорватия … Samsung потребляет почти 23 тераватт-часа, технологические гиганты вроде Google - чуть больше 12 тераватт-часов, а Microsoft - чуть больше 10 тераватт-часов для работы центров обработки данных, сетей и пользовательских устройств, согласно расчётам BI, основанным на отчёте Consumer Energy Solutions… - https://dzen.ru/a/Ze6wkOoVMDon...

В итоге — за цифрой воинствующая посредственность, ложь и неуемное пожирание ресурсов

А если прибавить сюда молниеносное распространение дебилизма в системе образования и безответственности в среде чиновничества — вот и получите основной навар от цифры.

Оценили 11 человек

21 кармы