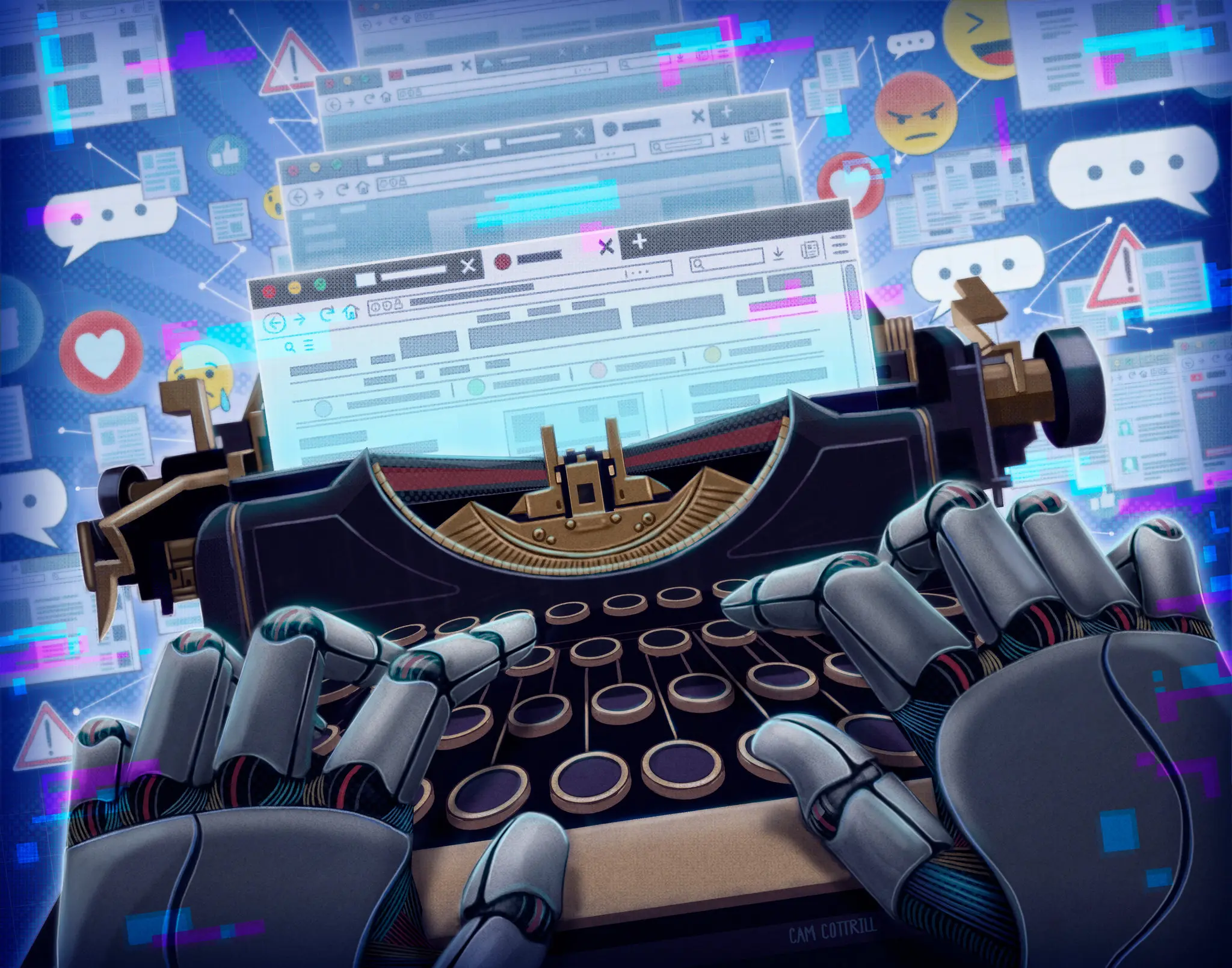

Как вы, дорогой читатель, вероятно знаете - есть специализированные LLM модели для генерации кода. Ну, те самые, из-за которых, как говорят, скоро все программисты останутся без работы, так как весь код будет генерировать ИИ.

Намедни же специалисты из университета Сан-Антонио в Техасе выкатили любопытное исследование. У нейросетей есть такое свойство, как галлюцинации. Она ведь, в общем-то, не то, чтобы "осознаёт" отдаваемый ответ. Скорее пытается "предсказывать" наиболее вероятное следующее слово во фразе. И если в обучающем наборе данных чего-то не было, нейронка может попытаться "угадать" что вам ответить.

Особенно это заметно на каких-то специализированных вопросах, например об авторстве того или иного текста, или вот при просьбах написать реализацию какого-то алгоритма.

Авторы исследования расковыряли 16 разных текстовых моделей с просьбами как раз реализовать ту или иную функциональность на языках python и javascript. Галлюцинировать стали абсолютно все испробованные модели. Причём очень специфическим образом - они запихивали в код несуществующие библиотеки. То есть LLM-ка предполагает, что такая библиотека с нужными зависимостями где-то в пакетных репозиториях есть и её можно использовать. Но на самом деле такой библиотеки нет и код вряд ли будет работать. Или нет.

Дело в том, что в отличие от электронных болванов - болван мясной может подойти к ситуации творчески. Поэтому товарищи хакеры быстренько сообразили, как галлюцинации ИИ-моделей использовать к своей выгоде. Они собрали наиболее часто встречающиеся "библиотеки-глюки", реализовали их, с внедрением туда вредоносного кода, и распространили в репозитории (наподобие npm или pypi) под видом вполне благонадёжного ПО.

Соответственно теперь человек, который пишет код с использованием ИИ - получает уже не несуществующую зависимость, а вполне себе имеющуюся библиотечку, которая может быть что-то ему нужное и делает. Но попутно ещё исполняет какую-то полезную работу для автора - например ворует персональные данные, платёжную информацию, или трудится в каком-нибудь ботнете. Кто же будет это проверять? Ведь нынче важно, что с помощью ИИ можно ускорить разработку, а вот что там точно под капотом - ни заказчик, ни разработчик в большинстве случаев исследовать не будут.

Лет эдак ещё через 5-10, вангую, количество ПО с внедрёнными вредоносами распространится невообразимо, и бизнесу-таки придётся призывать специалистов, которые умеют не только в формирование "промпта" к нейросетям, но и понимают как именно разгрести всё то, что ИИ нам наклепает за это время :) Так что поголовно уходить, скажем, в продавцы различных деревянных изделий в ближайшем Подмосковье - айтишникам точно не грозит.

Оценил 21 человек

25 кармы