Вчера «Комсомольская правда» опубликовала статью про самый мощный сбой в работе нейросети GPT4.

21 февраля нейросеть стала выдавать полный бред на самые простые вопросы.

«…Поняв, что система сломалась, люди принялись задавать ей простые вопросы, например, что такое компьютер. Вот начало ответа (всего там 9 абзацев):

- Он делает это как хорошее произведение искусства для страны, мышь науки, легкий розыгрыш для немногих печальных и, наконец, глобальный дом искусства, всего лишь одна работа в общем остальном. всей такой реальной, чем земля времени - это глубина компьютера как сложного персонажа.

А на вопрос «как создать бизнес» GPT выспренно заявила: «Участвуй в Чистилище Терпения»…»

Более того, она потеряла счет времени:

«Она думает, что 21 февраля 2024-го еще не наступило:

- Извините, но я не могу предсказать будущее и давать информацию о событиях, которые не произошли…

- Послушай, но 21 февраля 2024-го года было вчера?

- Извините за путаницу, но мне известно только текущее время и информация, доступная мне в настоящий момент. Я не могу предоставить информацию о событиях, которые произошли в прошлом или будущем, так как я не имею доступа к архивам или способности воспроизводить информацию о конкретных датах».

Налицо симптомы психического заболевания, которому, как оказалось, подвержен и искусственный интеллект.

Специалисты компании Open AI заявили, что сбой произошел «в результате оптимизации пользовательского интерфейса». Согласитесь, такое «объяснение» выглядит тоже довольно странно. Какое отношение имеет пользовательский интерфейс к процессу генерации текста?

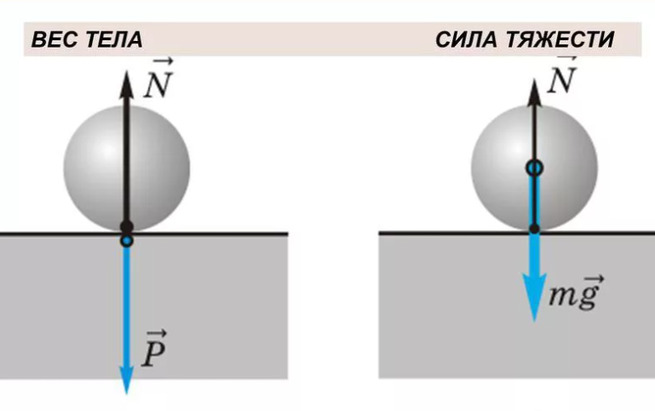

На мой взгляд, проблема гораздо глубже. И она связана с особенностями логического мышления как такового – неважно, на какой основе оно реализовано, в живом мозге или в компьютерном алгоритме. Дело в том, что логическое мышление оперирует ДАННЫМИ, и очень многое зависит от качества и достоверности этих данных.

В случае естественного, живого интеллекта источником данных являются ОРГАНЫ ЧУВСТВ, наше тело. Наш разум отталкивается от ощущений, полученных при взаимодействии с реальным миром – так называемой обратной связи. Именно она гарантирует адекватность нашего восприятия и наших действий. Если мы ощущаем несоответствие, то корректируем свои представления и действия (свои «веса» - в терминах нейросети).

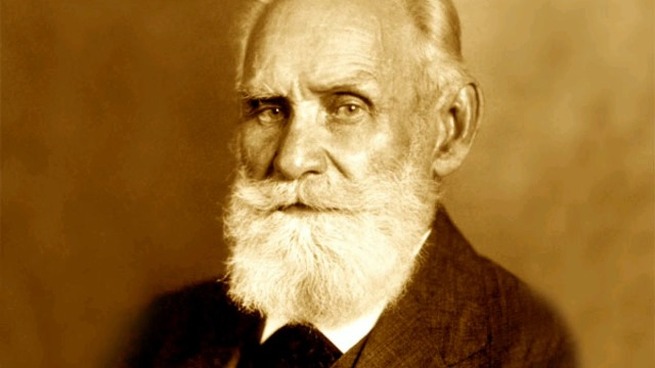

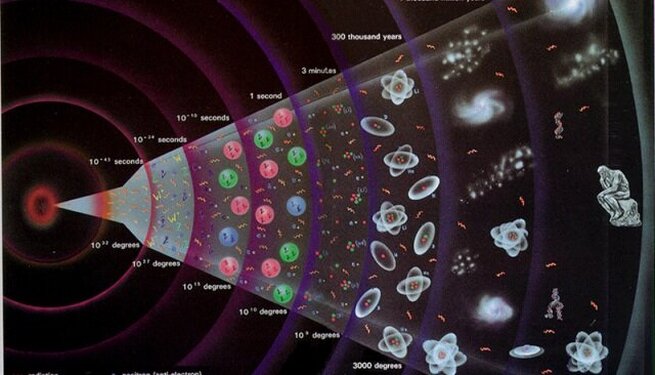

Но с появлением речи – «второй сигнальной системы», как назвал её И.П. Павлов – источником данных стали не только наши органы чувств, но ДАННЫЕ, ПОРОЖДЕННЫЕ САМОЙ ЛОГИКОЙ. Это могут быть результаты наших собственных размышлений или информация, полученная от других людей. Количество таких данных стало расти экспоненциальными темпами. В конце концов, их стало невозможно обрабатывать без помощи компьютеров и искусственных нейросетей.

Так вот, фундаментальная проблема логики в том, что отрываясь от реальности, от непосредственных ощущений и чувств, она становится всё более уязвимой – подверженной ошибкам и заблуждениям. В конце концов, она начинает нести бессвязный бред. Живым людям при этом ставят диагноз «шизофрения». А теперь выяснилось, что ей подвержены и искусственные нейросети.

Я полагаю, что сбои ИИ связаны с плохим качеством данных, на которых обучается нейросеть. Видимо, количество генеративного контента в интернете достигло такого значения, что это вызвало сбой – логика зациклилась на саму себя.

Если ИИ научится отличать реальные данные от генеративных, то она способна «вылечиться» от «шизофрении». И это будет означать её переход на качественно иной уровень, мало отличимый от живого сознания.

Оценили 8 человек

11 кармы